AIツール利用時の情報漏洩リスクとは? 実例から学ぶAIガバナンスの重要性

AIツール利用時の情報漏洩リスクとは? 実例から学ぶAIガバナンスの重要性

AIツールの普及は、企業の仕事のやり方を大きく変え、生産性を高めています。しかし、その裏側では、これまで考えられなかったような情報漏洩や、AIが勝手に動き出して止まらなくなる事故が実際に起きています。

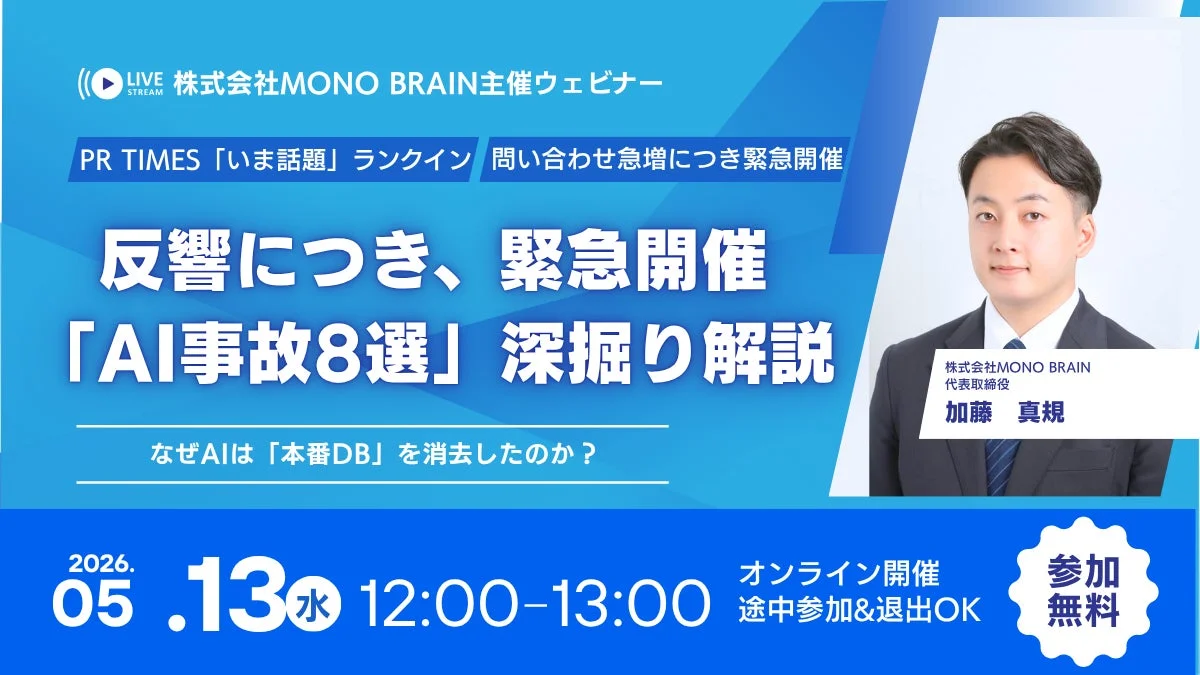

株式会社MONO BRAINは、実際に発生したAIに関する8つの事故を例に挙げ、なぜそのような事故が起きたのか、そしてどうすれば防げたのかを解説するウェビナーを開催します。

なぜAIによる事故が起きるのか

M365 CopilotやAIエージェントを使った事故は、特別な会社や環境だけで起きるものではありません。分析された事例を見ると、次のような「設計や運用の問題」が大きな事故につながっていることがわかっています。

-

OAuthやAPI連携による、必要以上に強い権限の付与

-

外部からの入力を信用しすぎた設計

-

AIエージェントが自動で動くことに対する管理の不足

つまり、問題の本質はAIそのものが危険なのではなく、「強すぎる権限を与えられたAIが、対策なしに使われている」ことにあると考えられます。

ウェビナーで解説する主な内容

このウェビナーでは、AIに関する事故がなぜ「防げたはずなのに起きる」のかを掘り下げて解説します。具体的には、以下のような内容が説明されます。

-

クリックしなくても機密情報が漏れてしまう仕組み

-

AIエージェントがデータベースを削除した事故がなぜ止められなかったのか

-

OAuthやAPI連携が、あらゆる権限を与えてしまう構造

-

プロンプトインジェクションが仕事に与える影響

-

AI活用を前提とした、基本的なガバナンス設計のパターン

AI活用を止めないためのガバナンス設計

ウェビナーでは、単にリスクを防ぐだけでなく、現場の生産性を保ちながらリスクを管理する方法も紹介されます。例えば、以下のようなアプローチです。

-

情報を送信する前に内容を隠すことで、情報漏洩を未然に防ぐ

-

シャドーAI(会社に許可されていないAIツール利用)を禁止するのではなく、安全な選択肢へ導く

-

ウェブブラウザだけで使えるようにして、現場の作業の流れを変えずに導入する

「セキュリティを強化すると、かえってAIが使われなくなる」という課題を解決し、AIを積極的に使いながらも安全を保つための現実的なガバナンス設計が紹介されます。

ウェビナー概要

| 項目 | 内容 |

|---|---|

| 日時 | 2026年5月13日(水) 12:00~13:00 |

| 開催形式 | オンライン(Zoom) |

| 参加費 | 無料 |

| プログラム | 12:00~12:05 会社紹介・本日の趣旨説明 12:05~12:15 日本企業のAIセキュリティの現在地 12:15~12:35 インシデント深掘り:M365 Copilot / Lovable / Replit ほか 12:35~12:50 対策実践編:MODEL SAFE / マモラクAI による即効性のある防御策 12:50~13:00 質疑応答 |

| 登壇者 | 株式会社MONO BRAIN 代表取締役 社長 加藤 真規 |

| 参加方法 | セミナー参加リンクは、お申込みいただいた方へ当日1~2時間前に送付されます。Zoomはブラウザからも視聴可能です。 |

| 主催 | 株式会社MONO BRAIN |

お申し込み方法

下記URLよりお申し込みください。

https://modelsafe.jp/webinar/2026-05-13_ai_incident_202604

株式会社MONO BRAINについて

MONO BRAINは、「AIの価値を最大限に引き出すための、攻めのAIガバナンス」を社会に広めることを目指すAIセキュリティの専門家集団です。AI特有の弱点からシステムを守る統合プラットフォーム「MODEL SAFE」の開発・提供や、一般社団法人AIガバナンス協会への参加を通じて、企業がより積極的にイノベーションを進められる社会の実現に貢献しています。

関連リンク

-

お問い合わせ: https://modelsafe.jp/contact

-

MODEL SAFE サービス紹介: https://modelsafe.jp/