GDEPソリューションズ、マルチGPU最適化基盤「G-RAGrid」とローカルAIエージェント「G-RAGent」の開発を発表

GDEPソリューションズ株式会社は、ローカルLLM(大規模言語モデル)やRAG(検索拡張生成)の活用を「構築」から「運用」まで一貫してサポートする新しいソリューション群として、「G-RAGrid(ジー・ラグリッド)」と「G-RAGent(ジー・ラジェント)」の開発を進めていることを明らかにしました。

既存の「G-RAGon」と合わせ、これら3つの製品により、より高度なローカルLLM/RAGソリューションの提供を目指します。

G-RAGrid:マルチGPU環境を最大限に活用するLLM実行基盤

これまでのローカルLLM/RAG環境では、GPU資源を効率的に使えなかったり、部署ごとにデータを分けるのが難しいといった課題がありました。

「G-RAGrid」は、複数のGPUを最大限に活用し、LLMを効率良く動かすための基盤として開発が進められています。開発や検証の段階ではOllamaを使い、実際の運用では高性能な推論フレームワークであるvLLMをロードバランシングで動かすことで、これまでの製品と比べて非常に高い性能が期待されます。

特に、最新のBlackwell世代のGPUが持つ大容量メモリを活かし、LLMに対する複数の処理を同時に効率良く実行できるため、たくさんの人が同時に利用してもスムーズに動かせることが特徴です。

また、処理の量が増えた場合には、ロードバランス機能によってGPUを追加するだけで、システムの規模を簡単に大きくできます。これにより、小さな規模での導入から会社全体での利用まで、段階的にシステムを広げることが可能です。

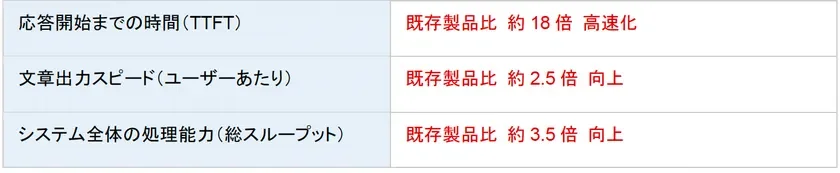

GDEPソリューションズが測定したベンチマーク結果では、既存製品と比べて応答開始までの時間が約18倍速く、文章出力スピードが1ユーザーあたり約2.5倍向上し、システム全体の処理能力も約3.5倍向上したと報告されています。

G-RAGent:自律的に業務をこなすローカルAIエージェント

「G-RAGent」は、自然な言葉で指示を出すだけで、AIが自分で考えて業務を進めるローカル環境で動くAIエージェントです。

LLMの考える力を使い、社内の資料を見ながらOffice系の書類を作ったり、溜まった社内資料を解説したりまとめたりする機能を、安全なローカル環境で実現することを目指して開発が進められています。

展示会への出展について

これらの新製品は、2026年4月15日(水)から17日(金)まで東京ビッグサイトで開催される「AI・人工知能EXPO【春】2026」に出展される予定です。小間番号は21-21です。

製品ページ

LLM/RAGシリーズの詳細については、以下の製品ページをご覧ください。

GDEPソリューションズ株式会社について

GDEPソリューションズ株式会社は、NVIDIA Partner Network(NPN)の認定を受けたソリューションプロバイダです。GPUコンピューティングの分野で多くの実績と高い技術力を持ち、NVIDIA製GPUを使った高性能なコンピューティング環境を提供しています。生成AIやLLMの開発・運用、HPC(高性能計算)、CAEシミュレーション、データ解析など、幅広い分野で顧客の課題解決を支援しています。

GDEPソリューションズ株式会社のウェブサイトはこちらです。

お問い合わせ先

本件に関するお問い合わせは、以下のフォームからご連絡ください。