日立ヴァンタラ、AIの主権を強化する「Hitachi iQ」に液冷式NVIDIA HGX B300サーバーを追加

日立ヴァンタラがAIインフラソリューション「Hitachi iQ」を拡充、最新液冷サーバーでAIの主権を強化

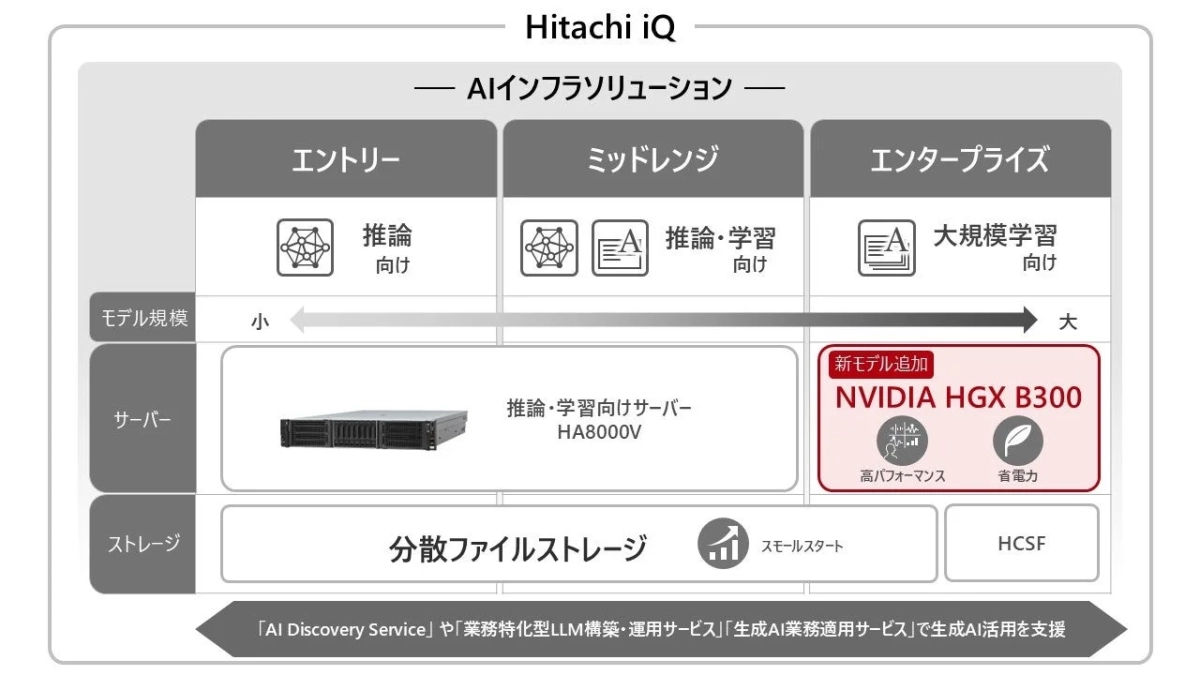

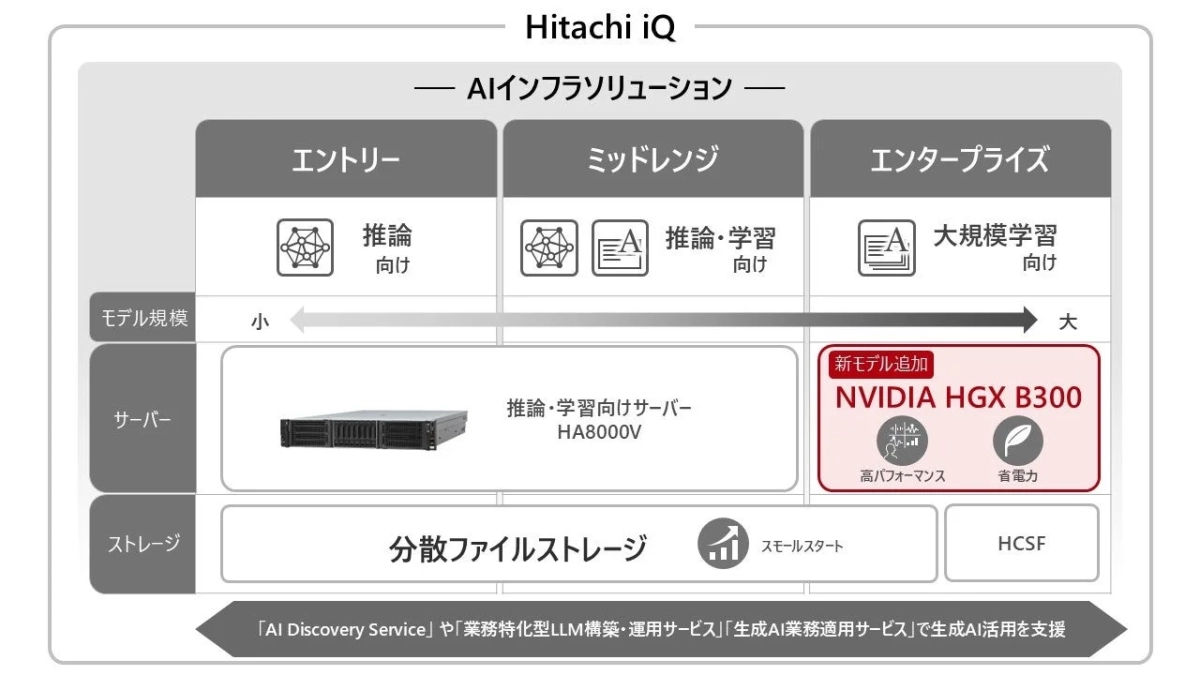

日立製作所のグループ会社である日立ヴァンタラは、AIインフラソリューション「Hitachi iQ」のエンタープライズモデルに、最新のNVIDIA Blackwell Ultra世代を搭載した「NVIDIA HGX B300 サーバー」の液冷モデルを追加し、日本国内で2026年3月27日より販売を開始しました。

この新しい製品は、AIやデータの主権(ソブリン性)が重要視される中で、企業が重要なデータを自社内で管理しつつ、AIの開発や実用化を加速できる環境を提供します。

背景:AIの進化とデータの主権

生成AIの技術が急速に進み、その活用範囲が広がっています。これに伴い、AIモデルをより速く、効率的に処理できる基盤が求められています。また、経済安全保障の強化やサイバー攻撃のリスクが高まる中、データやAIを自分たちで管理し、コントロールする主権(ソブリン性)の重要性が増しています。このような状況から、クラウドに頼らず、自分たちの場所で安全にデータを管理し、信頼性の高いAI基盤を構築することが求められています。

日立ヴァンタラは、日立グループ内で生成AI基盤を構築・運用してきた経験と知識を活かし、入門者向けから大規模企業向けまで、幅広いAIインフラソリューションを提供しています。

Hitachi iQ新エンタープライズモデルの主な特徴

1. 最新GPU搭載で大規模AIモデルを高速処理

NVIDIA HGX B300は、最新のNVIDIA Blackwell Ultra世代のGPUを搭載しており、大規模言語モデル(LLM)のような複雑なAIモデルを高速で処理できます。GPUのメモリー容量は、これまでのHGX B200の1.5倍にあたる最大2.1TBに増えました。また、GPUクラスター間の通信を速くする800Gb/sのネットワークにより、複数のGPUがスムーズにデータをやり取りでき、AIモデルの処理速度と安定性が大きく向上します。

2. 高効率な液冷モデルで消費電力と設置スペースを削減

NVIDIA HGX B300の液冷モデルは、空冷モデルと比べて消費電力を最大40%削減でき、運用コストを大きく下げられます。また、ラックに設置するスペースも最大60%削減できるため、データセンターでの設置効率が大幅に向上します。液冷による安定した冷却は、GPUの発熱を抑え、高い処理性能を長く維持することに貢献します。これにより、高性能なAIシステムを少ない電力で構築できます。

3. 高性能分散ファイルストレージがGPUサーバーの高速データ処理を支援

高性能分散ファイルストレージ「Hitachi Content Software for File powered by WEKA (HCSF) 」は、NVIDIA Cloud Partner (NCP) レベルで「NVIDIA-Certified Storage」の認定を受けています。これは、非常に高い拡張性(最大10,000 GPU)、しっかりとしたマルチテナント機能、そして厳格なサービス品質(QoS)制御という厳しい基準を満たしていることを示しています。HCSFとNVIDIA AI Enterpriseの連携により、検証済みの設計図や包括的なAIソフトウェアのライフサイクルサポートを通じて、製品やサービスをより早く市場に出すことが可能になります。

日立ヴァンタラは、これからも日立グループや世界のパートナーと協力し、エージェント型AIやフィジカルAIに最適なインフラソリューションを提供することで、顧客企業のビジネス革新と持続的な成長を支援していくとしています。

販売開始時期

NVIDIA HGX B300の空冷モデルはすでに販売・提供されています。液冷モデルは、2026年3月27日より販売を開始しています。

関連リンク

-

「Hitachi iQ」のウェブサイト: https://www.hitachivantara.com/ja-jp/solutions/ai-analytics/hitachi-iq

-

日立ヴァンタラ ウェブサイト: https://www.hitachivantara.com/

-

日立製作所 ウェブサイト: https://www.hitachi.com/ja-jp/

-

お問い合わせ先: https://www8.hitachi.co.jp/inquiry/hitachivantara/site-inq/form.jsp